- Optimization

딥러닝 학습시 최대한 틀리지 않는 방향으로 학습해야 한다,

얼마나 틀리는지(loss)를 알게 하는 함수가 loss function(손실함수)이다.

loss function 의 최솟값을 찾는 것을 학습 목표로 한다.

최소값을 찾아가는 것 최적화 = Optimization

이를 수행하는 알고리즘이 최적화 알고리즘 = Optimizer 이다.

- 옵티마이저 중에 가장 많이 쓰이는게 Adam 아담.

- Adam, Adaptive Moment Estimation : Momentum + AdaGrad 합친 것임

- 학습이 빠르고 안정적이며, 대부분의 모델에서 별다른 튜닝 없이도 잘 작동하기 때문에 가장 많이 사용

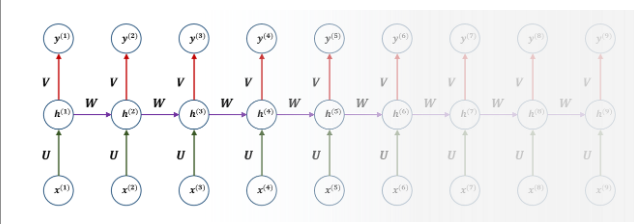

- 장기 의존성 문제, The problems of long-term dependencies

: 은닉층의 과거의 정보가 마지막까지 전달 되지 않는 현상

> RNN에서 발생하며, 이를 해결한 것이 LSTM