- 대부분의 딥러닝 기법은 인공신경망을 사용

- 인공신경망은 여러 개의 Hidden Layer를 가지고 있음

- 데이터에서 수동으로 특징을 추출하지 않고, 학습을 통해 적절한 특징을 찾을 수 있는 능력을 학습

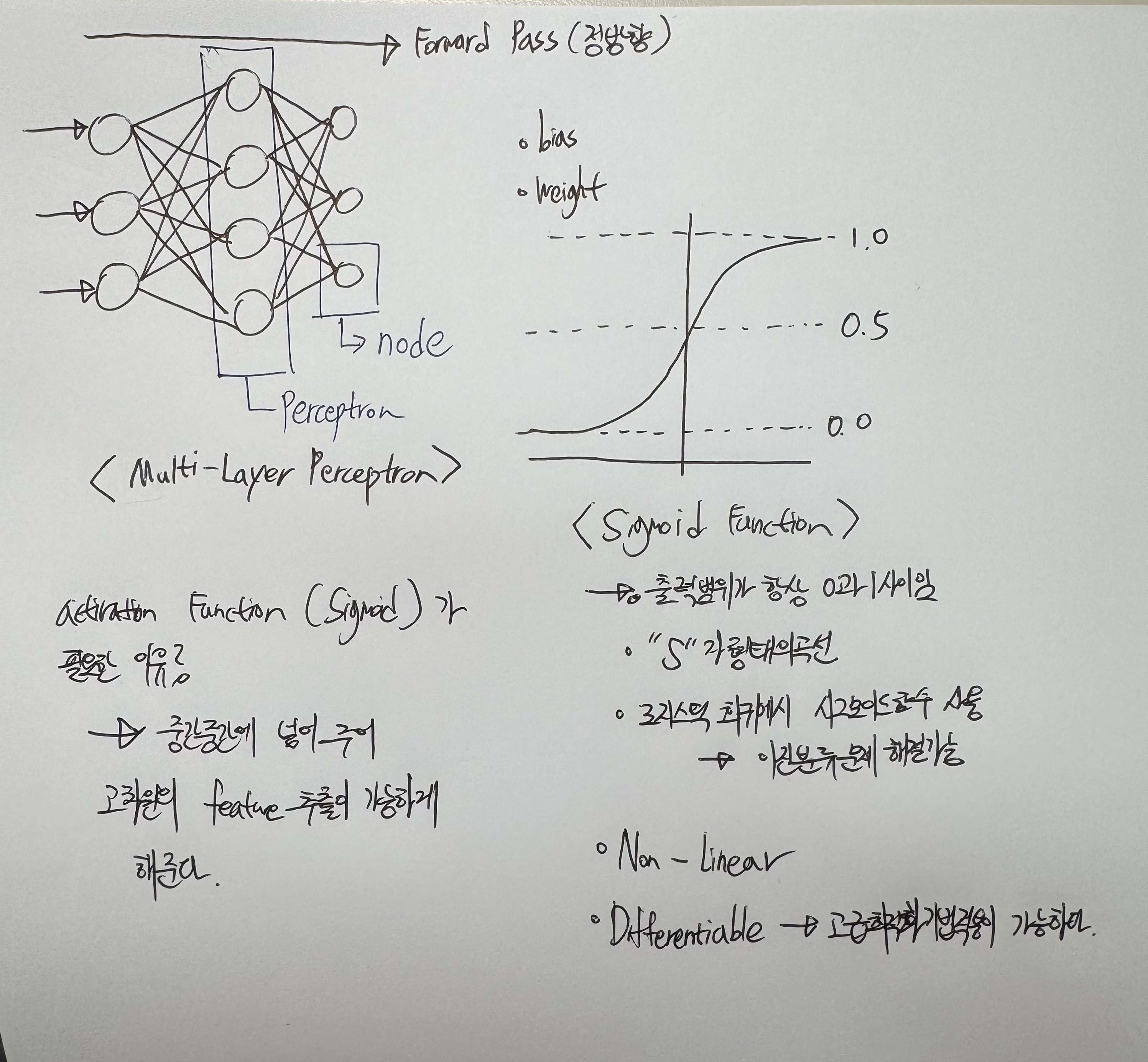

- DNN에서 Hidden Layer 수가 많을수록 고차원의 feature 특징 학습이 가능해짐

- 그러나 Non-Linearlity 제공을 하지 않으면 의미가 없음. 고차원 feature 특징 학습이 불가능함

- 따라서 각 Hidden Layer에 비선형성 부여위한 Activation Function 들어가야함

Activation 함수는 "비선형 부여" 반드시 기억하자

Hidden Layer 많이 쌓을 때 고차원 feature 학습 위해서 비선형 부여해야 한다는 것도

- Perceptron은 이진 분류( Binary Classification )에 적용이 가능

- Positive Class: +1

- Negative Class: -1

- Z 값이 Threshold 보다 크거나 같으면 Positive, 작으면 Negative로 판별